Populární témata

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

RT, aby pomohla Simonovi zvýšit povědomí o rychlých injekčních útocích v LLM.

Vypadá to trochu jako divoký západ raných počítačů, s počítačovými viry (nyní = škodlivé výzvy skrývající se ve webových datech/nástrojích) a ne dobře vyvinutou obranou (antivirem nebo mnohem rozvinutějším paradigmatem zabezpečení jádra/uživatelského prostoru, kde např. agent dostává velmi specifické typy akcí místo schopnosti spouštět libovolné bash skripty).

Rozporuplný, protože chci být prvním osvojitelem LLM agentů ve svých osobních počítačích, ale divoký západ možností mě drží zpátky.

16. 6. 2025

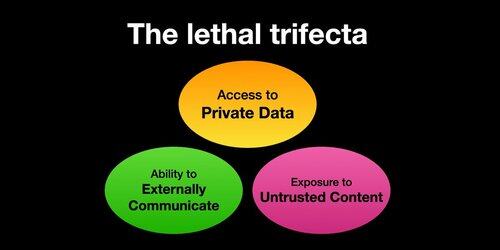

Pokud používáte "AI agenty" (LLM, které volají nástroje), musíte si být vědomi Lethal Trifecta

Kdykoli zkombinujete přístup k soukromým datům s vystavením nedůvěryhodnému obsahu a schopností komunikovat externě, může útočník oklamat systém a přimět jej ke krádeži vašich dat!

Měl bych objasnit, že riziko je nejvyšší, pokud provozujete místní agenty LLM (např. Cursor, Claude Code atd.).

Pokud právě mluvíte s LLM na webové stránce (např. ChatGPT), riziko je mnohem nižší, *pokud nezačnete zapínat konektory. Například jsem právě viděl, že ChatGPT přidává podporu MCP. To se bude obzvláště špatně kombinovat se všemi nedávno přidanými paměťovými funkcemi – např. představte si, že ChatGPT řekne vše, co o vás ví, nějakému útočníkovi na internetu jen proto, že jste zaškrtli špatné políčko v nastavení konektorů.

385,97K

Top

Hodnocení

Oblíbené