热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

转发以帮助西蒙提高对大型语言模型中的提示注入攻击的认识。

感觉有点像早期计算机的西部荒野,计算机病毒(现在 = 隐藏在网络数据/工具中的恶意提示),以及防御措施不够完善(杀毒软件,或者更为成熟的内核/用户空间安全范式,例如,代理被赋予非常具体的操作类型,而不是运行任意 bash 脚本的能力)。

感到矛盾,因为我想在个人计算中早期采用大型语言模型代理,但这种可能性的西部荒野让我感到犹豫。

2025年6月16日

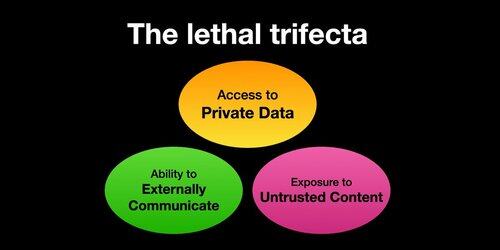

如果你使用 "AI 代理"(调用工具的 LLM),你需要意识到致命三重奏

每当你将对私密数据的访问与对不可信内容的暴露以及外部通信的能力结合在一起时,攻击者就可以欺骗系统窃取你的数据!

我应该澄清一下,如果你在运行本地 LLM 代理(例如 Cursor、Claude Code 等),风险是最高的。

如果你只是通过网站与 LLM 交谈(例如 ChatGPT),风险要低得多,*除非*你开始启用连接器。例如,我刚看到 ChatGPT 正在添加 MCP 支持。这将与最近添加的所有记忆功能结合得特别糟糕——例如,想象一下 ChatGPT 将它所知道的关于你的所有信息告诉互联网上的某个攻击者,仅仅因为你在连接器设置中勾选了错误的选项。

385.99K

热门

排行

收藏