热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

Runway 刚刚发布了 Gen-4.5。

它现在是世界上第一的 AI 视频模型。

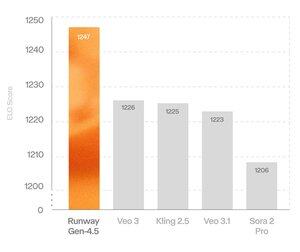

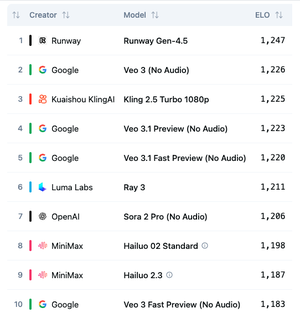

数字:

→ 人工分析排行榜上的 ELO 分数为 1,247

→ 超过谷歌的 Veo 3、Kling 2.5 和 OpenAI 的 Sora 2 Pro

→ 全球顶级模型

核心能力:

→ 前所未有的物理准确性(真实的重量、动量和力)

→ 精确渲染复杂的多元素场景

→ 在多样的美学中保持视觉一致性

→ 从单一提示中进行复杂的相机编排

→ 处理逼真和风格化的动画

有什么不同:

• 完全基于NVIDIA GPU(Hopper和Blackwell系列)构建

• 与Gen-4相同的速度和定价

• 所有现有控制模式将转移到Gen-4.5(图像到视频、关键帧、视频到视频)

当前的局限性:

1. 因果推理问题:一扇门可能在某人触摸把手之前就打开。效果可能先于原因。

2. 物体恒常性问题:一个杯子在被遮挡视线后可能消失,然后在下一个画面中重新出现。

3. 成功偏见:行动成功的频率过高,例如,一个瞄准不准的篮球投篮仍然进球。

已经被以下公司使用:

→ Target(零售和电子商务)

→ BBC(广播)

→ Ubisoft(游戏)

Runway表示将在接下来的几天内向所有人开放。

我的收获:

两年前,Runway 发布了 Gen-1,这是第一个公开可用的视频生成模型。

现在他们正在设定一个新的基准。

我们离真正理解现实世界运作方式的系统又近了一步。

我能感受到视频生成竞赛真的在加速,我们都将从这场竞争中受益。

关注我 @thealexbanks,获取每日的AI亮点和见解。

📌 ELO 排行榜讲述了这个故事。

Runway Gen-4.5 以 1,247 分领先,领先第二名 Google 的 Veo 3 21 分。

为了提供背景:这是在人工分析文本到视频基准上测试的,该基准评估运动质量、提示遵循和视觉保真度,涵盖数千次生成。

考虑到 OpenAI 的资源,Runway(1247)与 Sora 2 Pro(1206)之间的差距是显著的。

1.83K

热门

排行

收藏