Populární témata

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

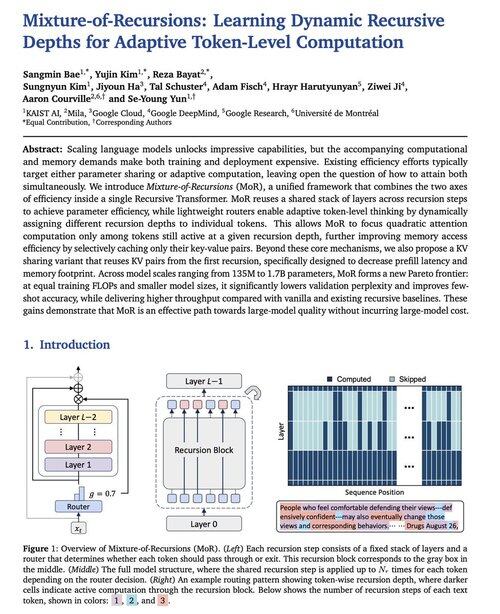

Google DeepMind právě upustil od této nové architektury modelu LLM s názvem Mixture-of-Recursions.

Získává 2x rychlost inference, snížené trénovací FLOPy a ~50% sníženou KV cache paměť. Opravdu zajímavé čtení.

Má potenciál stát se zabijákem Transformers.

Zdroj:

127,26K

Top

Hodnocení

Oblíbené