熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

PUMP 公售結束了,原本我也是大額在Bybit,鏈上只放1/2,最後只有鏈上的打成功,還好沒有提前套保…

話說最近AI社群上很多人在討論 VLA(Vision‑Language‑Action)

特別去研究了一下鏈上項目有沒有人在做VLA相關的,看到了這個 CodecFlow @Codecopenflow 的項目,買了一點。

== CodecFlow這項目在幹嘛 ==

簡單介紹一下VLA,VLA 是一種讓 AI 不只「能說」,而是「能做」的模型架構。

傳統的 LLM(像 GPT)只能理解語言、提供建議,但它不會動手操作、不會點擊畫面、不會抓取物體。

VLA 模型的意思就是整合了三大能力:

1. Vision(視覺):看得懂畫面、截圖、攝影機輸入或感測器資料

2. Language(語言):理解人類的自然語言指令

3. Action(動作):產生可執行的指令,如滑鼠點擊、鍵盤輸入、控制機械手臂

CodecFlow 他們就是在做鏈上的VLA,所有操作流程還可以上鏈,可審計、可驗證、可結算。

簡單來說就是 “AI 機器人” 的基礎架構。

== 為什麼我會特別注意這項目?==

我發現他們的開發者是 VLA 領域最火開源專案 LeRobot 的核心貢獻者!

LeRobot 就是開源界打造 VLA 模型的頂級基地,包含了 SmolVLA 等能在筆電上跑的輕量 VLA。

代表這團隊是真的懂VlA架構懂Robot的。

我看他們也持續的在建設,幣價也穩定的在上漲,我自己是很看好VLA賽道,而且從整體趨勢來看VLA跟機器人在市場上確實是未來。

• Web2 巨頭(Google、Meta、Tesla)目前已全力投入 VLA & 機器人訓練;

• Web3 項目好少有能執行任務的 VLA 應用還非常稀缺

• VLA 有機會在 DePIN、Web Automation、鏈上 AI Agent 執行等場景發揮巨大價值。

CA:69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

Always DYOR。

2025年6月26日

什麼是 $CODEC 運算符?

這是視覺-語言-行動模型最終使 AI 在實際工作中發揮作用的地方。

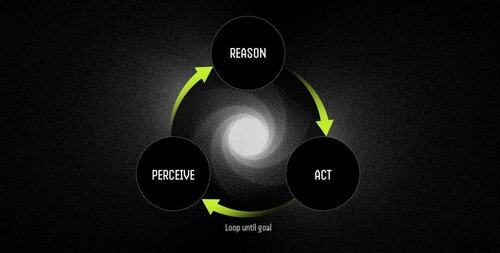

Operator 是由 VLA 模型提供支援的自主軟體代理,它通過連續的感知-推理-行為迴圈來執行任務。

LLM 可以出色地思考和交談,但他們不能指向、點擊或抓取任何東西。它們是純粹的推理引擎,在物理世界中沒有任何基礎。

VLA 將視覺感知、語言理解和結構化動作輸出結合在單個前向傳遞中。LLM 描述了應該發生的事情,而 VLA 模型實際上是通過發出座標、控制信號和可執行命令來實現的。

Operator 工作流為:

- 感知:捕獲螢幕截圖、攝像頭源或感測器數據。

- 推理:使用 VLA 模型處理觀察結果和自然語言指令。

-作:通過UI交互或硬體控制執行決策 - 所有這些都在一個連續迴圈中完成。

示例:LLM 與 Operator Powered by VLA 模型

安排會議

LLM:提供日曆管理的詳細說明,概述安排會議的步驟。

具有 VLA 模型的運算子:

- 捕獲使用者的桌面。

- 標識日曆應用程式(例如 Outlook、Google 日曆)。

- 導航到星期四,在下午 2 點創建會議,並添加出席者。

- 自動適應使用者介面更改。

機器人:對對象進行排序

LLM:生成用於對對對象進行排序的精確書面說明,例如識別和組織紅色元件。

具有 VLA 模型的運算子:

- 實時觀察工作區。

- 識別混合物件中的紅色分量。

- 為機械臂規劃無碰撞軌跡。

- 執行拾取和放置作,動態調整到新的位置和方向。

VLA 模型最終彌合了可以推理世界的 AI 和可以真正改變世界的 AI 之間的差距。它們將自動化從脆弱的規則遵循轉變為適應性問題解決能力 - 智能員工。

“當環境發生變化時,傳統腳本會中斷,但 Operator 使用視覺理解來實時適應,處理異常而不是崩潰。”

10.7K

熱門

排行

收藏