Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Forsikring er en undervurdert måte å låse opp sikker AI-fremgang på.

Forsikringsselskaper er motivert til å sannferdig kvantifisere og spore risiko: hvis de overvurderer risiko, blir de utkonkurrert; Hvis de undervurderer risikoen, vil utbetalingene deres slå dem konkurs.

1/9

Ideelt sett ville vi styrt AI på en måte som både:

- Akselererer utvikling og distribusjon av kunstig intelligens

- Kvantifiserer og forhindrer risikoene som virkelig betyr noe

Forsikringsselskaper ønsker rask AI-adopsjon (de kan selge mer AI-forsikring) - og for å unngå alvorlige hendelser (de betaler regningen)

Faktisk har forsikring spilt denne rollen for nye teknologibølger i minst 270 år:

Brann: På 1700-tallet ble Philadelphias befolkning tidoblet. Etter hvert som byen vokste, ble trehusene tettere. Brann herjet byen. I 1752 temmet Benjamin Franklin brannene ved å opprette USAs første brannforsikringsselskap. Forsikringsselskapet hadde skinn i spillet for å forhindre branner - de betalte for skader. Franklin laget tidlige byggeforskrifter for å designe tryggere hus, og håndhevet dem gjennom branninspeksjoner. Å temme brannene gjorde det mulig for Philadelphia å fortsette å vokse.

Biler: I etterkrigstidens Amerika økte dødsfall i bilulykker kraftig. Bilforsikringsselskapene betalte den økonomiske regningen. I 1959 opprettet de Insurance Institute of Highway Safety. Forsikringsselskaper utviklet standarder for bilkollisjonstesting som oppmuntret bilprodusenter til å utvikle tryggere biler. De skapte økonomiske insentiver for bruk av sikkerhetsbelte og kollisjonspute før reguleringen trådte i kraft. Bedre biler gjorde det trygt for biler å bli vanlige - og bidro til å redde hundretusenvis av liv.

Kjernekraft: I 1957 skapte Price-Anderson Act den private atomenergiindustrien i Amerika. I hjertet er en forsikringsordning. Den ble designet for å gjøre det mulig for atomoperatører å drive risikable kraftverk med markedstilsyn, samtidig som ofrene ble økonomisk beskyttet i tilfelle en ulykke. Privat forsikring dekker ulykker opp til 16 milliarder dollar før en statlig backstop slår inn for å dekke katastrofale risikoer. Dette gir regjeringen fordelen av godt insentivert private markedsaktører som fører tilsyn med den daglige risikostyringen.

Tilbake til AI:

Hvordan, nøyaktig, kan forsikring balansere AI-fremgang og sikkerhet?

Her er kjernen:

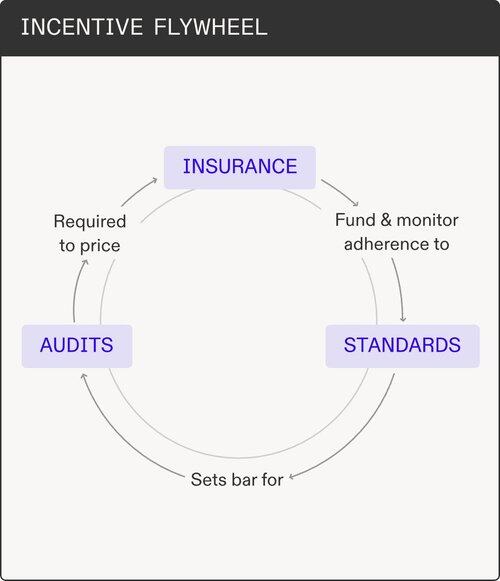

Forsikringsselskaper har insentiver og makt til å håndheve at selskapene de forsikrer iverksetter tiltak for å forhindre risikoene som betyr noe. De håndhever sikkerhet gjennom et insentivsvinghjul:

Forsikringsselskapene lager standarder. Standarder skisserer hvilke risikoer som betyr noe og hva selskaper bør gjøre for å forhindre dem. AI-selskaper ønsker å sertifisere seg mot standarder fordi det hjelper dem å få tillit fra kundene sine og fordi det gjør dem kvalifisert for forsikring - akkurat som vi ser i cybersikkerhet i dag med SOC 2.

Standarder setter deretter standarden for revisjoner. Forsikringsselskaper reviderer risikoer før de forsikrer dem. De får tilgang til privat informasjon slik at de kan se om standardene faktisk er oppfylt. Revisjoner gir standarder tenner for håndhevelse.

Revisjoner lar i sin tur forsikringsselskapene prise risikoen mer nøyaktig. Når de tar feil, oppdaterer de standardene for å gjenspeile de reelle risikoene.

Dette svinghjulet dukker tydeligst opp i AI-agenter for kommersielle risikoer – men det strekker seg til laboratorier og datasentre for katastrofale risikoer.

AI-insentivsvinghjulet dukker opp:

-GitHub forsikrer kundene for å vinne tillit

-Laboratorier samles om sikkerhetsforpliktelser, det vil si tidlige standarder

-METR presser på for tekniske evalueringer for å muliggjøre bedre revisjoner

-RAND legger grunnlaget for datasenterstandarder

99,43K

Topp

Rangering

Favoritter