Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

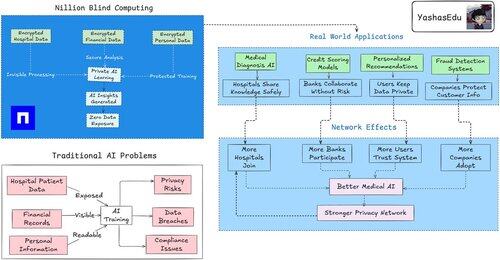

La privacidad de los datos en la IA se está convirtiendo en un tema crítico. Los sistemas actuales requieren exponer datos para que la IA aprenda de ellos, lo que crea riesgos para la información confidencial.

@nillionnetwork publicado su hoja de ruta para 2025 para construir una infraestructura de "computación ciega" donde la IA pueda procesar datos sin verlos realmente.

+ Fase 0 (Q2): Se centraron en el almacenamiento distribuido con cifrado que permitía consultas privadas de LLM

+ Fase 1 (Q3): Los modelos de IA pueden realizar cálculos sobre datos privados mientras mantienen la auditabilidad (@Tickrdotapp ya están disponibles, hay más productos de infraestructura en marcha)

+ Fase 2 (Q4): Herramientas de desarrollo e interfaces para acelerar la adopción

Todos sabemos que al usar @nillionnetwork, los sistemas de IA pueden aprender patrones y proporcionar información sin acceder a información sin procesar.

> tecnología de coprocesamiento ZK amplía las capacidades para las operaciones de IA/ML

> Crea infraestructura para el aprendizaje automático privado a escala

> Combina el procesamiento de IA + principios de descentralización

Esto aborda las crecientes preocupaciones sobre la exposición de datos en el entrenamiento de IA.

A medida que los modelos se vuelven más poderosos, proteger la información confidencial mientras se mantiene la funcionalidad de la IA se vuelve esencial. @nillionnetwork será más importante.

7 jul, 20:01

Presentamos la hoja de ruta tecnológica de Nilionon para 2025.

Estamos avanzando en Blind Computer hacia una computación más profunda y una experiencia de desarrollador fluida.

Vamos a sumergirnos 🧵

1.63K

Populares

Ranking

Favoritas